Category:情報理論

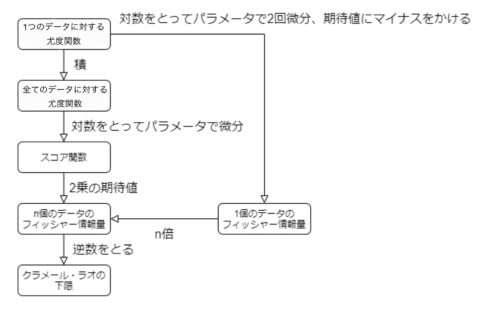

フィッシャー情報量

Fisher information

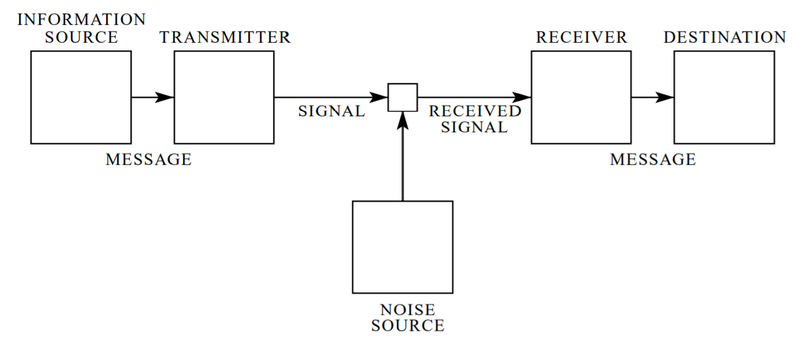

ハリー・ナイキスト

Harry Nyquist

情報理論上の未解決問題

List of unsolved problems in information theory

エントロピック重力

Entropic gravity

最小権限の原則

Principle of least privilege

情報熱

結合エントロピー

Joint entropy

ダメラウ・レーベンシュタイン距離

Damerau–Levenshtein distance

傾向推定

Linear trend estimation

ウラジーミル・レーベンシュタイン

Vladimir Levenshtein

符号レート

Code rate

ブラ-ケット記法

Bra–ket notation

二値エントロピー関数

Binary entropy function

レイ・ソロモノフ

Ray Solomonoff

通信路容量

Channel capacity

符号化率

ロブ・クリング

Rob Kling

Common data model

Common data model

エントロピー不確定性

Entropic uncertainty

冗長性 (情報理論)

Redundancy (information theory)

情報源レート

二分バンド幅

Bisection bandwidth

スペクトル効率

Spectral efficiency

位相因子

Phase factor

バーレカンプ–ウェルチアルゴリズム

Berlekamp–Welch algorithm

エントロピーレート

Entropy rate

ギブスの不等式

Gibbs' inequality

エルウィン・バーレカンプ

Elwyn Berlekamp