Category:情報理論

クロード・E・シャノン賞

Claude E. Shannon Award

冗長性 (情報理論)

Redundancy (information theory)

情報源レート

ウラジーミル・レーベンシュタイン

Vladimir Levenshtein

エルウィン・バーレカンプ

Elwyn Berlekamp

バーレカンプ–ウェルチアルゴリズム

Berlekamp–Welch algorithm

最小記述長

Minimum description length

情報熱

エントロピーレート

Entropy rate

MIMO

MIMO

位相因子

Phase factor

ソロモン・ゴロム

Solomon W. Golomb

ロバート・ファノ

Robert Fano

グレゴリー・チャイティン

Gregory Chaitin

ファノの不等式

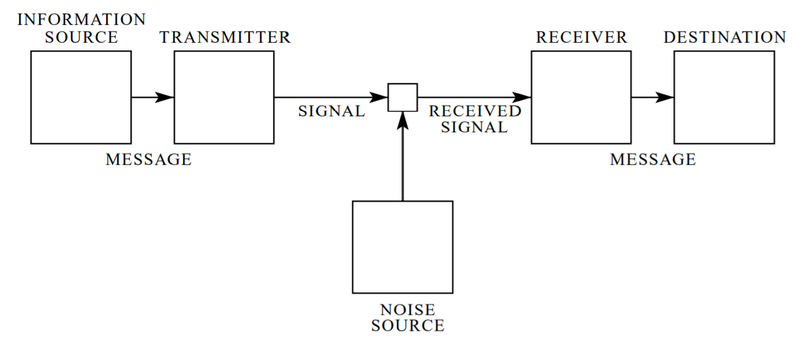

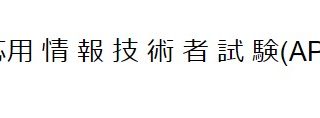

Fano's inequality通信の数学的理論

A Mathematical Theory of Communication

情報量

Entropy (information theory)

標本化定理

Nyquist–Shannon sampling theorem

カルバック・ライブラー情報量

Kullback–Leibler divergence

相互情報量

Mutual information

帯域幅

Bandwidth (signal processing)

ブラ-ケット記法

Bra–ket notation

レイ・ソロモノフ

Ray Solomonoff

最小権限の原則

Principle of least privilege

乱数生成

Random number generation

交差エントロピー

Cross-entropy

情報理論

Information theory

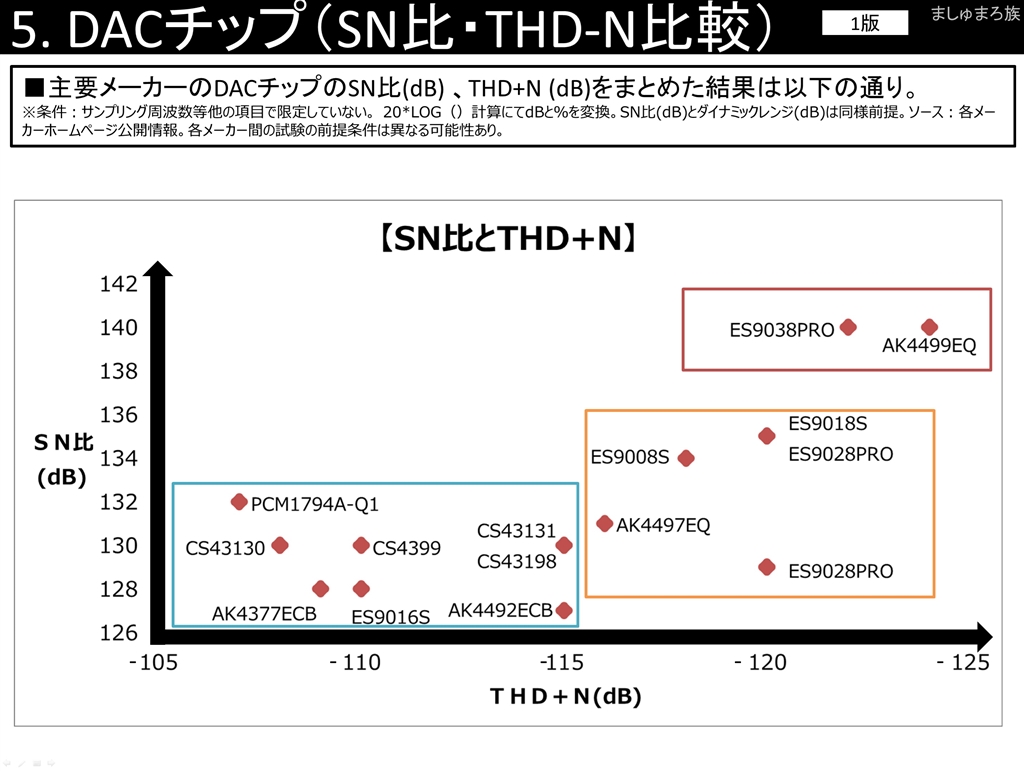

SN比

Signal-to-noise ratio